随着 Vultr DeepSeek 服务的正式上线,国产大模型 R1 终于迎来了海外云厂商的满血支持。对于正在寻找稳定 DeepSeek API推荐 的开发者来说,Vultr 提供的 Serverless Inference 无疑是一个强有力的替代方案,特别是当官方 API 频频出现不稳定的情况下。

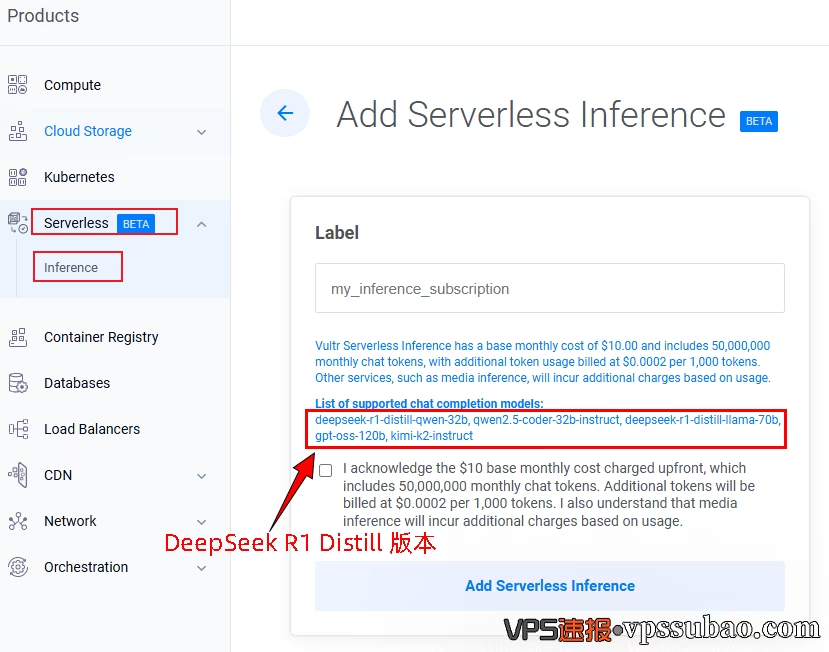

Vultr 后台明确列出了支持的 DeepSeek R1 Distill 模型列表,并标明了 $10 美元包 5000 万 Token 的订阅制价格。

但 Vultr 并没有采用常见的按量计费,而是推出了 $10/月 的订阅模式。这个价格到底是“割韭菜”还是“真香”?VPS速报将为您带来最硬核的 Vultr Serverless教程 与选择指南。

一、Vultr DeepSeek 上线的是哪个版本?

很多用户担心云厂商挂羊头卖狗肉。我们直接看 Vultr 后台的实锤截图,确认 Vultr DeepSeek 支持的具体型号。

Vultr 后台明确列出了支持的 DeepSeek R1 Distill 模型列表,并标明了 $10 美元包 5000 万 Token 的订阅制价格。

从图中蓝色列表可以看出,Vultr 提供的是 Distill(蒸馏)系列:

- deepseek-r1-distill-llama-70b (旗舰款):这是使用 Llama-3.3-70B 作为基座,用 R1 的输出数据进行微调蒸馏的模型。它的逻辑推理能力接近原版 R1,但推理速度极快。

- deepseek-r1-distill-qwen-32b:基于通义千问微调,速度更快,适合对延时极其敏感的场景。

二、Vultr DeepSeek价格审计:5000万 Token 够用吗?

Vultr 这次没有采用主流的“按量计费”,而是搞了个“自助餐”模式。让我们来详细审计一下 Vultr DeepSeek价格 体系。

1. 计费规则详解

根据官方页面显示:

- 入场费: $10.00 / 月 (不可按小时退款)。

- 包含餐标: Vultr 5000万Token (50,000,000 Chat Tokens)。

- 超额加餐: $0.0002 / 1k Tokens。

如果您是 Vultr 的新用户,在支付这 $10 之前,建议先查看《Vultr优惠码 2026:最新折扣码与促销活动汇总》,领取新用户赠金来抵扣其他服务器的开销。

成本控制:

- 避免隐形扣费: $10 仅是 API 订阅费。如果您在测试过程中挂载了临时硬盘,测试结束后请务必参考 Vultr删除块存储教程,以免产生额外的闲置资源账单。

- 精细化预算: 如果涉及海量训练数据的长期保存,块存储可能太贵,建议参考 Vultr对象存储价格 选择更低成本的归档方案。

2. Vultr 5000万Token 是什么概念?

为了让大家对这个量级有直观概念,我们换算一下:

- 中文汉字: 约等于 3000万 – 4000万 个汉字。

- 代码行数: 约等于 500 万行 Python 代码。

- 书籍: 相当于把《红楼梦》(约70万字)让 AI 读或者写 50 遍。

3. 价格对比:Vultr vs OpenAI

| 服务商 | 模型 | 5000万 Token 预估成本 |

|---|---|---|

| Vultr DeepSeek | R1 Distill (70B) | $10.00 (固定) |

| DeepSeek 官方 | DeepSeek V3/R1 | 约 $27 – $109 (取决于缓存命中) |

| OpenAI | GPT-4o | $250.00+ |

三、Vultr Serverless教程:开发者实战指南

Vultr 的 Serverless Inference 完全兼容 OpenAI API 规范。这意味着您不需要学习新的 SDK,直接用现有的 OpenAI 库就能跑通。

1. 获取配置信息与环境准备

部署成功后(点击 Add Serverless Inference),您需要在 Vultr 后台找到 API Key 和 API URL。

进阶建议: 如果您不仅是调用 API,还打算在 Vultr VPS 上部署一个 24 小时运行的 AI 智能体(Agent)(相关搭建流程可参考:OpenClaw教程:如何在 VPS 上一键部署个人多端 AI 助理),请务必确保服务器有足够的数据持久化能力。具体的硬盘挂载方案可查阅《Vultr块存储配置全解析:Portal、API与Terraform四种挂载方案》。

- API Key: 以

sk-开头的密钥。 - API URL:

https://api.vultr.com/v1

2. DeepSeek R1 Python调用示例

在运行代码前,如果您对硬盘的读写性能有较高要求(例如需要保存海量对话日志),建议先参考《Vultr块存储购买与使用指南:性能对比、价格、挂载教程与扩容策略》来选择合适的存储类型。以下是使用 Python 进行 DeepSeek R1 Python调用 的标准代码,您可以直接复制使用:

from openai import OpenAI

# 初始化客户端,指向 Vultr 的地址

client = OpenAI(

api_key="YOUR_VULTR_API_KEY", # 替换为您的 Vultr Key

base_url="https://api.vultr.com/v1"

)

response = client.chat.completions.create(

model="deepseek-r1-distill-llama-70b", # 必须填对图中的模型名

messages=[

{"role": "system", "content": "您是一个专业的 Python 助手"},

{"role": "user", "content": "请用 Python 写一个贪吃蛇游戏"}

],

stream=True # 开启流式输出,体验更快

)

for chunk in response:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")

3. Curl 命令行测试

如果您习惯使用终端(新手推荐阅读《Xshell连接VPS图文教程:SSH登录与连接超时完美排查》来远程管理服务器),也可以用以下命令快速测试连通性:

curl https://api.vultr.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_VULTR_API_KEY" \

-d '{

"model": "deepseek-r1-distill-llama-70b",

"messages": [{"role": "user", "content": "Vultr DeepSeek 怎么样?"}],

"temperature": 0.7

}'

四、Vultr DeepSeek 5000万 Token 值得订阅吗

Vultr 这波操作非常精准,它筛选了特定的用户群体。在下单前,请对号入座:

1. 推荐购买人群

-

- 重度开发者: 需要跑自动化脚本、翻译大量文档、做 RAG (检索增强生成) 的。如果涉及海量知识库存储,还可以配合 Vultr对象存储 来构建完整的 AI 数据闭环;或者通过《Vultr NFS挂载实战:Storage Gateway免费共享存储指南(API版)》,利用高性能的 NFS 共享存储来实现多节点的数据并发读取。

- 构建知识库: RAG 系统通常需要配合海量非结构化数据存储。您可以结合《Vultr对象存储全攻略:S3 兼容性、API 开通与 Terraform 部署》打造一套完整的“推理+存储”AI 闭环架构。

-

- AI 微服务玩家: 如果您打算将 AI 智能体容器化,对于追求自动化的生产环境,推荐参考《Vultr Kubernetes (K8s) 教程:0元搭建 VKE 集群 (Terraform版)》;而对于需要实时监控推理服务健康状态的用户,则可以查看《K3s Dashboard 安装教程:3步解锁可视化管理 (含 Token)》,实时监控推理服务的健康状态。

- 团队用户: 一个 Key 给全公司几个人共用,Vultr 5000万Token 刚好够用。

- 稳定性刚需: 无法忍受 DeepSeek 官网频繁报错,急需一个备用接口的。

2. 劝退人群

- 尝鲜党: 只是听说 R1 很火,想聊两句天。

- 低频用户: 一个月问答不超过 1000 次的,花 $10 太亏了。对于这类需求,其实买一台 便宜月付 VPS 自己在本地部署一个量化版的小模型玩玩,成本可能更低,具体的低成本方案可以参考:DigitalOcean AI模型 部署:免显卡跑 DeepSeek R1 与 Llama 3。

总体而言,Vultr DeepSeek 是目前市面上少有的“量大管饱”型 API 服务。如果您正好有高频的 AI 推理需求,这 10 美元绝对能帮您省下大笔开销。