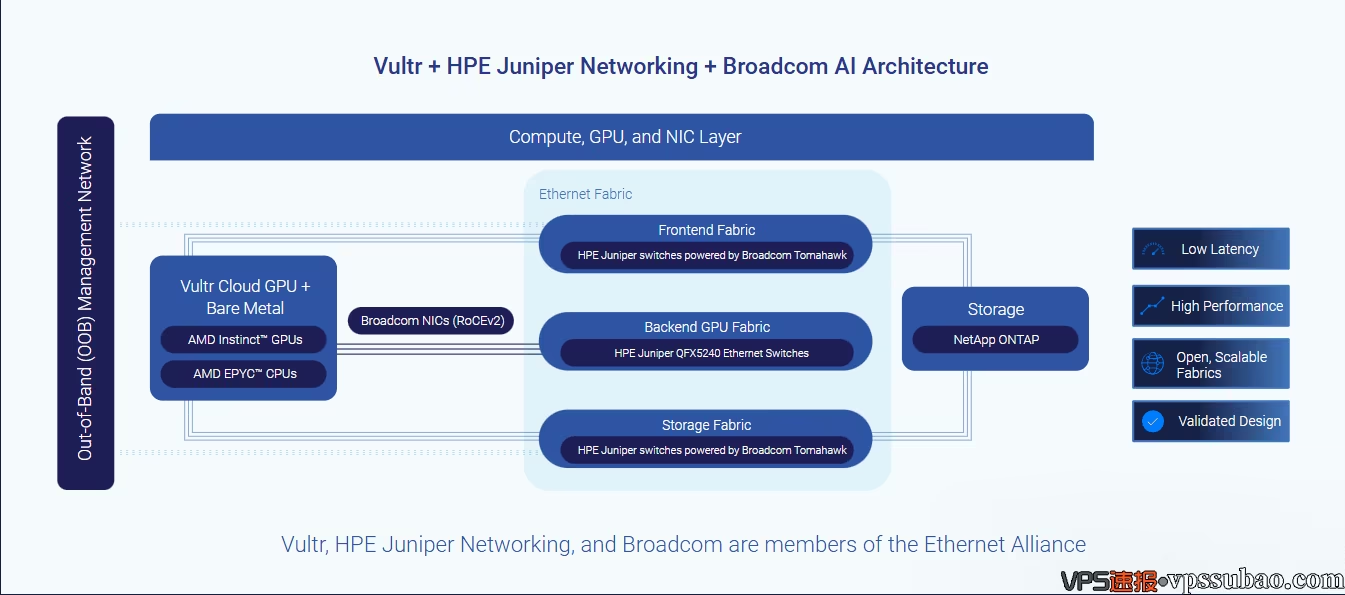

近日,全球领先的云服务商 Vultr 官方宣布了一项重磅行业合作,旨在全面升级 Vultr AI 网络 基础设施。为了满足大型语言模型训练和复杂数据推理的苛刻需求,Vultr 正式联合博通(Broadcom)与 HPE 瞻博网络,共同打造了企业级的云端算力底座。这套全新的网络架构深度集成了 博通 Tomahawk 5 交换芯片与高性能的 Thor 2 网卡,专门为 Vultr GPU 集群 提供稳定、高效的数据传输通道。通过全面部署 RoCEv2 无损网络,该方案不仅能提供 高吞吐量低延迟云服务器 体验,更从根本上 解决 AI 算力网络拥堵 的难题,确保企业级用户的昂贵算力资源得到最大化利用。

一、为什么需要彻底改造底层网络设施?

随着人工智能技术的爆发,企业对大规模算力的需求呈指数级增长。然而,在实际的生产环境中,许多研发团队发现,当他们的 Vultr GPU 集群 在进行复杂的分布式训练时,往往受到底层网络带宽和延迟的严重限制。当海量数据在不同节点间同步时,底层存储的读写速度和挂载方式首先要跟上(关于高级挂载技巧,建议参考 Vultr块存储配置全解析:Portal、API 与Terraform四种挂载方案)。但即便存储性能够强,传统的网络协议仍极易产生丢包和微秒级延迟,直接导致昂贵的 GPU 处于闲置等待状态。

为了 解决 AI 算力网络拥堵 这一核心痛点,Vultr 意识到必须从底层硬件和网络协议入手进行推翻重构。仅仅增加 CPU 或硬盘容量已经无法满足时代需求,构建一个具备确定性性能、极低延迟的 Vultr AI 网络 成为了 Vultr 近期技术演进的重中之重。

二、三大巨头如何重塑网络底座

本次发布的生产级云网络架构,并非简单的硬件资源堆砌,而是深度整合了业内最顶级的网络技术栈。Vultr 将算力、存储与先进网络无缝集成,大大降低了用户自行部署的门槛。

Vultr 官方发布的高性能 AI 网络基础架构:展示了底层算力、以太网交换骨干与存储结构的深度融合。

1. 算力与通信边缘:博通 Thor 2 网卡

在数据流出的第一站(服务器节点端),Vultr 选用了博通专为 AI 数据中心优化的 Thor 2 网卡。这款 400G 级别的企业级网卡支持硬件级 RoCE 卸载(RDMA over Converged Ethernet)和 GPU-direct 数据直接迁移技术。通过 Thor 2 网卡 强大的硬件级拥塞控制能力,服务器能够以极高的效率处理海量吞吐请求,这是打造 高吞吐量低延迟云服务器 的第一道物理保障。

2. 核心网络大脑:博通 Tomahawk 5 交换芯片

在至关重要的交换层,核心动力来自于 博通 Tomahawk 5 顶级交换芯片。这款芯片专为云规模的确定性数据包处理而设计。面对大模型训练时的突发性高并发负载,博通 Tomahawk 5 引入了虚拟输出队列(VOQ)调度机制和动态共享缓冲区技术。这意味着它能够实现极为先进的负载均衡,维持持续的线速性能,彻底杜绝数据包在交换机内部发生积压或丢失。

3. 坚实的以太网骨干:HPE 瞻博网络

优秀的硅芯片需要极其稳定的设备载体。为此,Vultr 在其全球范围内的数据中心广泛部署了搭载博通芯片的 HPE 瞻博网络(HPE Juniper QFX5240)以太网交换机集群。通过将顶尖硬件与 HPE 瞻博网络 久经考验的交换结构统一集成,Vultr 成功构建了一个无需用户手动干预、高度一致的全局云网络生态。

三、开放的以太网协议释放算力潜能

传统的专有互联网络(如 InfiniBand)虽然性能优异,但建设成本过于高昂,且存在严重的供应商锁定问题。Vultr 此次联合推出的新方案,坚定地走向了基于标准以太网的开放生态路线。结合交换层的智能调度与节点端的网卡卸载,这套架构在云端完美实现了真正意义上的 RoCEv2 无损网络。

对于企业级客户而言,RoCEv2 无损网络 带来了立竿见影的财务与业务双重收益。它不仅提供了可预测的稳定吞吐量,极大缩短了 AI 模型的训练与推理周期,还通过降低大规模互联产生的电力消耗,显著压缩了基础设施的总体拥有成本(TCO)。

这套成熟的商业化设计,成功帮助客户 解决 AI 算力网络拥堵 问题,让技术团队能够结合自动化的容器编排(如需实操演练,可参考本站的 Vultr Kubernetes (K8s) 教程:0元搭建 VKE 集群 (Terraform版)),将全部精力集中在算法创新和模型调优上,而不是耗费在无休止的网络故障排查中。

四、广泛的企业级应用场景落地

得益于这套坚如磐石的基础设施,目前的 Vultr GPU 集群 已经具备了处理工业级复杂任务的强悍实力,完全能够满足众多受监管行业的严苛合规与性能要求:

- 金融服务领域:通过部署 高吞吐量低延迟云服务器,机构能够轻松支撑近乎实时的反欺诈检测分析与庞大的高频交易模型演算。

- 医疗与生命科学:高带宽以太网为大规模基因测序、高清医学影像处理和前沿 AI 药物研发提供了可靠、安全的数据流转通道。考虑到此类业务会产生海量需要长期归档的数据,建议企业配合性价比更高的静态存储方案使用(资费标准请查阅 Vultr对象存储价格详解:四大套餐区别与收费标准指南(2026新版))。

- 制造与能源产业:利用极其稳定的确定性网络,完美支持复杂的数字孪生系统、工业机器人调度与实时的工业数据分析。

无论您身处哪个科技赛道,这套由博通和 HPE 瞻博网络 深度赋能的全新 Vultr AI 网络 架构,都能为您提供高度一致、可无缝重复部署的生产环境。这标志着 Vultr 正在重塑全球云计算行业的性能标杆。对于那些急需大规模部署无瓶颈算力的企业来说,今天的 Vultr 已经提供了极具吸引力的终极解决方案。

五、云端 AI 算力与容器化生态的其他选择

Vultr 此次联合博通与 HPE 瞻博网络打造的底层架构无疑是行业顶尖水准。但如果您的业务处于初创期,或者对特定型号的 GPU 有强烈需求,市场上同样有其他极具竞争力的云服务商值得关注。

例如,如果您需要部署当前炙手可热的顶级算力芯片,DigitalOcean 也提供了极高性价比的租赁方案。有需求的用户可以对比阅读我们的深度评测:DigitalOcean GPU 服务器:比 AWS 便宜 75% 的 H100 租赁指南,以便为您的大模型训练找到最优成本解。

当然,如果顶级 H100 的造价超出了团队目前的预算,或者您的主要业务集中在轻量级的 AI 推理和深度学习模型微调上,那么主打高性价比的裸机显卡方案会是更务实的选择。您可以进一步了解 JustHost GPU VPS:NVIDIA T4/A16 裸机显卡,AI大模型与深度学习首选,它能以更低的门槛,满足大部分初创项目对独立显存和稳定算力的硬性需求。

另外,无论是运行 AI 推理节点还是常规的微服务架构,高可用的 Kubernetes 集群都是现代企业 IT 的标配。除了前文提到的 Vultr VKE,如果您正在规划多云部署策略,也可以了解一下 DigitalOcean Kubernetes (K8s):比 AWS 便宜 90% 的企业级方案。多对比几家主流厂商的容器化生态,能帮助您的团队构建出更健壮、更经济的云端基础设施。