欢迎来到这篇最详尽的 OpenClaw安装教程。如果您正在寻找一份完整且结构清晰的 OpenClaw教程 指南,希望能为自己打造一个专属的、多端互通的个人 AI 助理,那么这篇文章将满足您的所有需求。本文是一份保姆级的 OpenClaw部署教程,VPS速报将重点讲解如何通过官方脚本实现高效的 OpenClaw一键部署。为了让您的 AI 助理能够保持全天候 24 小时在线运行并保障数据隐私,我们强烈推荐使用 VPS安装OpenClaw,这也是目前业界公认的最佳实践方案。

OpenClaw 部署教程:跟随本指南在 VPS 服务器上搭建您的专属 AI 大脑

一、 什么是 OpenClaw?为什么需要这篇 OpenClaw 安装教程?

OpenClaw(前身为 Moltbot)不仅是一个普通的聊天机器人程序,更是一个高度可定制的个人 AI 助理中枢。它的核心优势在于“统一”与“记忆”:您可以将它同时接入 WhatsApp、Telegram、Slack 甚至 Discord。这意味着无论您在哪个平台发消息,背后的 AI 大脑都是同一个,它拥有统一的上下文和长期记忆数据库。

在本地设备上运行虽然可行,但如果您希望 AI 能够随时随地响应您的指令、处理后台定时任务(如收发邮件、定时网页检索),那么选择一台云端服务器进行操作是明智之举。通过本篇 OpenClaw 安装教程,您将彻底掌握如何把这套强大的系统稳定的搭建在自己的服务器上。

二、 VPS 安装 OpenClaw 的前期准备工作

在开始正式的命令行操作之前,我们需要确保服务器环境符合项目运行的基础要求。这一步是整个系统稳定运行的基石。

1. 硬件与系统要求

虽然 OpenClaw 本身不需要进行耗费算力的 AI 推理(推理过程是通过调用外部大模型 API 完成的),但在构建镜像和维持网关运行时仍需要基础的内存空间。我们建议的最低配置如下:

- CPU: 1核及以上

- 内存: 强烈推荐 2GB RAM 及以上(1GB 内存极易在构建镜像时发生内存溢出导致进程中断)

- 硬盘: 15GB SSD 及以上可用空间

- 操作系统: Ubuntu 24.04 LTS(推荐全新安装的纯净系统)

在准备服务器时,优秀的网络连通性是保障 AI 响应速度的关键因素。如果您正在考虑购入新机器,可以参考我们之前对 荫云 (Yin-Net) 美国双ISP VPS:三网回程路由追踪、延迟丢包与带宽实测 的详细评测。

另外,如果您的服务器配置较高,在运行 OpenClaw 助手之余,还可以将它的富余算力利用起来,具体可阅读 K3s 安装教程:3分钟让闲置 VPS 变身轻量级 K8s 集群,让您的服务器发挥最大价值。

2. 基础环境配置:安装 Docker

OpenClaw 官方强烈推荐使用 Docker 容器化技术来进行部署。这样不仅可以完美隔离系统环境,还能极大的简化安装流程。您需要确保服务器上以非 root 用户(具有 sudo 权限)身份安装了 Docker 以及 Docker Compose。

三、 核心部署:一键安装脚本与基础设置

万事俱备,接下来我们将正式进入 OpenClaw 的核心安装环节。得益于官方提供的自动化脚本,整个服务端部署过程被极大的简化了。但在真正启动脚本之前,我们需要先处理好 VPS 系统的目录权限,这是确保后续所有配置与 API 密钥能够顺利保存的最关键一步。

1. 关键权限配置与执行一键部署脚本

在正式运行部署脚本之前,有一个极其重要的前置步骤。由于 OpenClaw 容器内部默认以 UID 为 1000 的普通用户运行,而我们的 VPS 通常是最高权限的 root 账户。如果直接运行,这会导致容器在保存 API 密钥时必定出现 EACCES: permission denied 的权限报错。

为了确保部署过程如丝般顺滑,我们需要提前在主机上创建配置目录,并将该目录的所有权移交给容器虚拟用户。请在终端直接复制并执行以下两行快速命令:

mkdir -p "$HOME/.openclaw" chown -R 1000:1000 "$HOME/.openclaw"

权限配置彻底打通后,请确保您目前仍在 openclaw 源码目录中,然后执行以下一键部署命令:

./docker-setup.sh

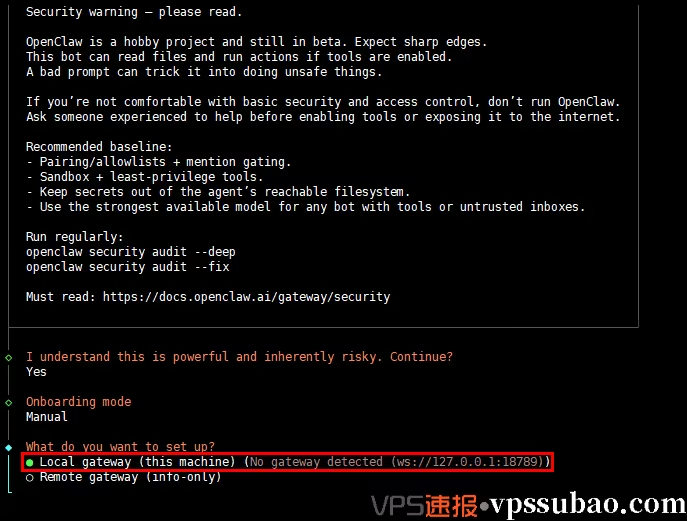

脚本运行后,系统不会直接静默安装,而是会弹出一个非常人性化的交互式配置向导(Interactive Wizard)。请按照屏幕提示进行操作:

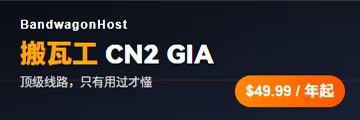

- 安全声明确认: 第一步,系统会弹出 Security warning 界面,提示您运行 AI 代理存在一定的安全责任。请使用键盘的左右方向键将绿点选中“Yes”,然后敲击回车继续。

在交互式配置向导中阅读并确认安全声明

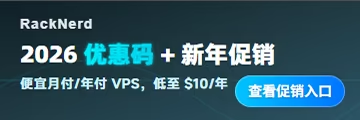

- 配置模式选择 (Onboarding mode): 确认安全声明后,向导会询问您配置模式。为了能一步到位的完成所有核心设置,请使用下方向键选择 Manual(手动配置),并回车确认。

选择 Manual 模式,以便在部署阶段一次性完成 AI 模型与渠道的绑定

- 网关类型选择 (Gateway Setup): 紧接着,系统会询问您要设置哪种网关。由于我们是直接在这台 VPS 上运行完整的服务端,请保持默认选中的 Local gateway (this machine),直接回车确认。

选择 Local gateway,在此 VPS 服务器上直接搭建完整网关服务

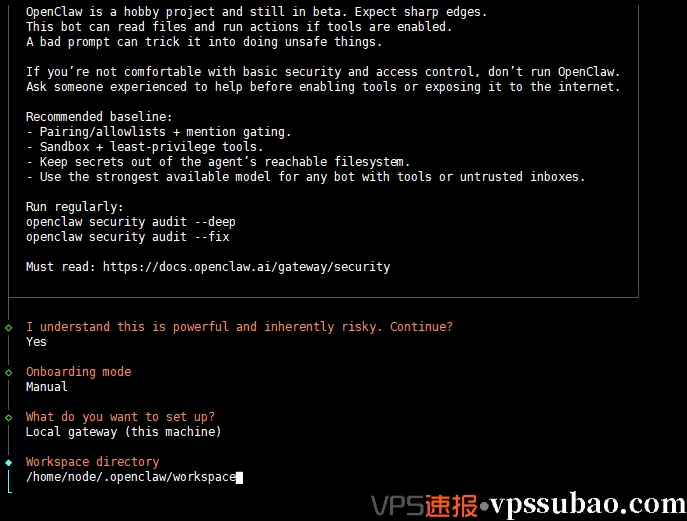

- 工作区目录设置 (Workspace directory): 接下来,系统会要求您确认工作区目录。这里存放着 AI 助手的全部记忆文件和缓存数据。为了保证容器权限正常,请直接使用系统默认填写的

/home/node/.openclaw/workspace,敲击回车继续即可。

进阶提示:随着 AI 助手处理的文档和数据增多,工作区目录可能会占用较多空间。如果您的 VPS 本身硬盘较小,建议您考虑挂载外部网络存储。具体操作方案可以参考 Vultr NFS挂载实战:Storage Gateway免费共享存储指南(API版),为您的 AI 记忆库扩展无限容量。

直接回车确认,使用默认的 Workspace 目录来存储 AI 的记忆与缓存数据

2. 如何获取大模型 API Key?

很多第一次接触 VPS 安装 OpenClaw 的读者在这里会不知所措。请注意,OpenClaw 只是一个调度中枢(躯干),它需要接入外部的 AI 大模型(大脑)才能工作。而 API Key(应用程序接口密钥)就是这些厂商发给您的专属通行证。以下是获取目前主流模型密钥的方法,您可以任选其一:

- OpenAI (ChatGPT): 行业标杆,能力最强。请访问 OpenAI 开发者平台 (platform.openai.com),登录后在左侧菜单进入“API keys”生成。特别提醒:OpenAI 目前必须绑定海外信用卡并充值后,生成的 Key 才能正常调用。

- Moonshot AI (Kimi): 国内用户首选,网络连通性极佳,中文理解力极强。访问 Moonshot 开放平台 (platform.moonshot.cn),使用手机号注册后,进入“API Key 管理”点击新建即可快速获取,新用户通常自带免费测试额度。

- Google (Gemini): 对开发者非常友好,免费额度慷慨。访问 Google AI Studio (aistudio.google.com),使用谷歌账号登录并点击“Create API key”生成。

- DeepSeek (高阶推荐): 如果您对代码推理能力有极高要求,并且需要消耗海量的 Token 额度,不妨参考我们的 Vultr DeepSeek R1 教程:$10订阅享5000万Token全解析,为您的 OpenClaw 接入目前极具性价比的顶尖大脑。

安全警告:无论您获取了哪家的 API Key,都等同于您的钱包密码,请绝对保存在本地,切勿在公开网页或截图中泄露!

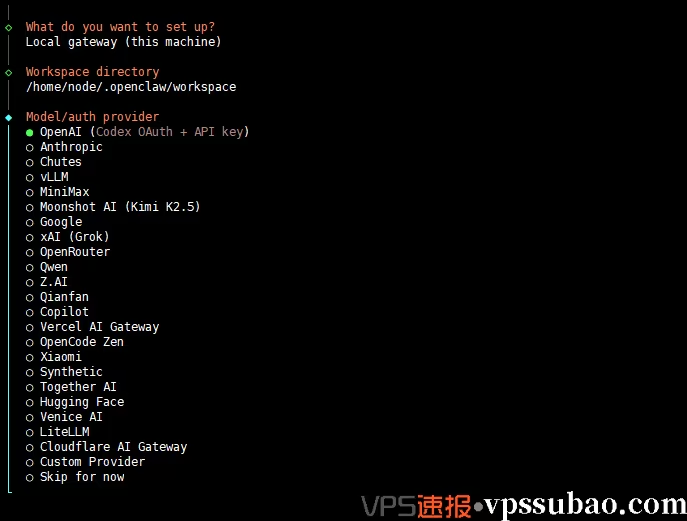

3. 配置大模型与网关安全

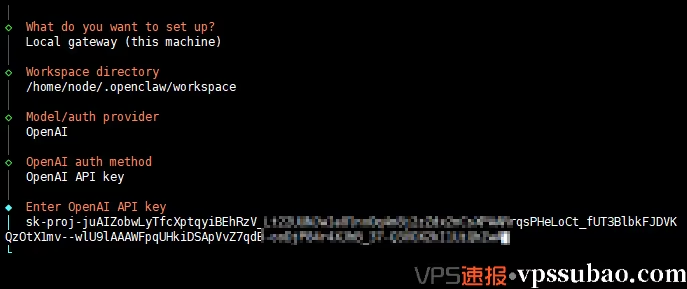

- 模型提供商设置 (Model/auth provider): 准备好 Key 之后,回到我们的终端配置向导。使用上下方向键,选择您对应的服务商(例如本教程演示的 OpenAI),敲击回车。

选择您的大模型提供商,为 OpenClaw 注入 AI 大脑

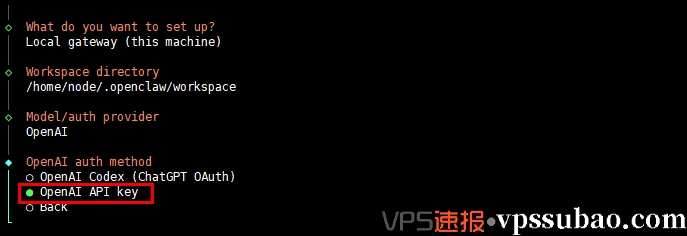

- 选择认证方式 (Auth method): 选中提供商后,系统会询问具体的认证方式。请使用下方向键选择 OpenAI API key 并回车。

选择 OpenAI API key 方式进行直连授权

- 输入并确认 API 密钥: 接着,系统会提示

Enter OpenAI API key。请将您刚才生成的专属 API 代码安全的粘贴进去(终端里可能不会显示密码的星号,粘贴一次即可),然后再次敲击回车,即可彻底完成 AI 大脑的绑定!

粘贴您专属的 API 密钥并回车(注意保护您的密钥安全,请勿泄露)

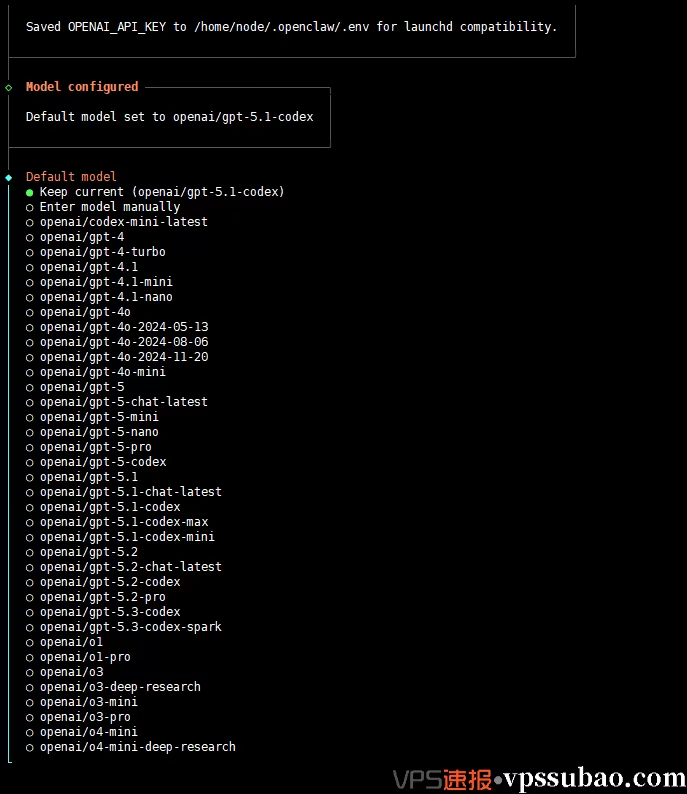

- 选择默认 AI 模型 (Default model): 顺利解决权限问题并输入密钥回车后,屏幕顶部会弹出

Saved OPENAI_API_KEY...的提示,这标志着您的大脑已成功接入!紧接着,向导会列出该服务商旗下的所有可用模型版本。为了保证最佳的兼容性和系统执行能力,建议直接保持默认选中的 Keep current 选项,直接敲击回车确认即可。

密钥保存成功,直接回车确认 OpenClaw 运行的默认大模型版本

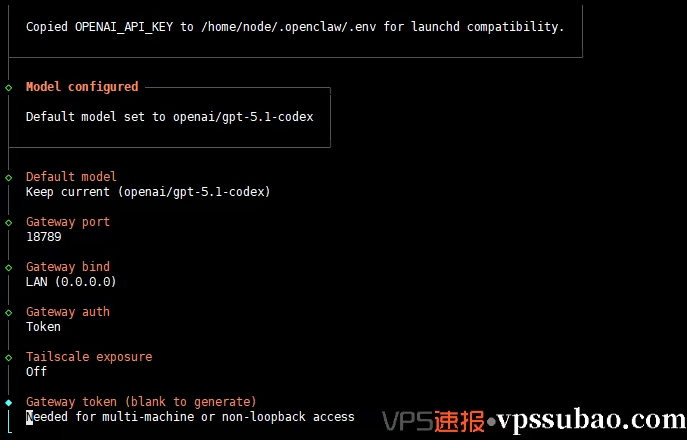

- 设置网关通讯端口 (Gateway port): 确认完模型后,系统会要求设置网关端口,默认值为

18789。这个端口是 OpenClaw 核心服务与外部通讯的专属通道。对于绝大多数全新部署的 VPS 服务器,此端口均为空闲状态,请直接敲击回车键(Enter)保留默认设置即可。

直接回车确认,使用系统默认的 18789 端口作为网关通讯通道

- 网关绑定设置 (Gateway bind): 这一步至关重要。系统默认选中 Loopback (127.0.0.1),但这会导致外部设备无法连接。请使用下方向键选中 LAN (0.0.0.0) 并回车。这样设置后,您的 OpenClaw 才能通过 VPS 的公网 IP 接受来自 Telegram 或管理后台的请求。

选择 LAN (0.0.0.0),确保您的 AI 助手可以接受来自外部网络的指令

- 网关认证方式 (Gateway auth): 为了保护您的服务不被非法占用,系统会要求设置认证方式。建议直接选择默认推荐的 Token 并回车。系统随后会生成一串专属的访问令牌,请务必将它妥善保存,这是您未来登录管理后台的唯一凭证。

选择推荐的 Token 认证,为您的 AI 助手构建第一道安全防线

- 内网穿透设置 (Tailscale exposure): 随后系统会询问是否开启 Tailscale 穿透。由于我们已经开启了 LAN 公网访问,这里直接回车选择 Off 即可,无需额外配置。

由于 VPS 具备公网 IP,此处选择 Off 即可跳过内网穿透设置

- 网关令牌生成 (Gateway token): 最后,系统会提示设置访问令牌。为了确保最高的安全强度,建议直接留空并敲击回车,让系统自动为您生成一串复杂的随机 Token。

直接回车让系统自动生成专属 Token,它是您远程管理 AI 的唯一凭证

在您留空回车后,系统已经为您静默生成了高强度的随机 Token 并加密保存到了后台配置文件中。为了安全起见,它不会直接显示在安装屏幕上。安装完成后,您可以随时通过查看 ~/.openclaw/.env 文件来获取这串通行证,请务必妥善保管,切勿泄露。

四、 接入 Telegram 与开启 AI 技能

基础的网络与大模型配置完成后,您的 OpenClaw 其实已经具备了“思考”的能力。但为了让它真正融入您的日常工作与生活,我们需要将它绑定到您熟悉的通讯软件中,并为它装载强大的扩展功能。接下来,我们将为您演示如何把它打造成一个专属的移动端全能助手。

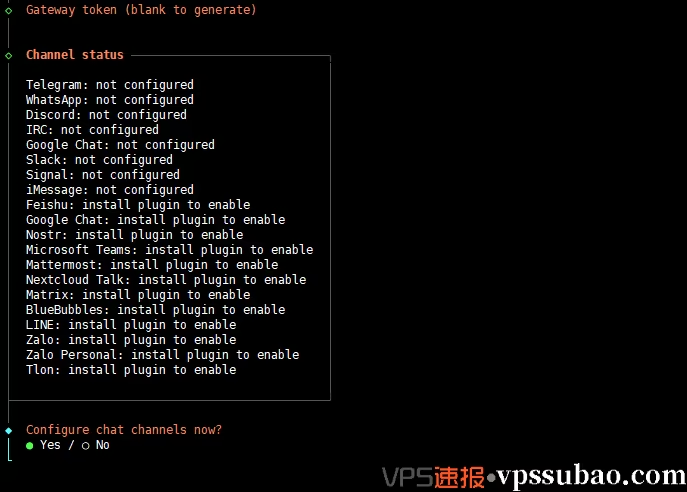

1. 接入 Telegram 机器人

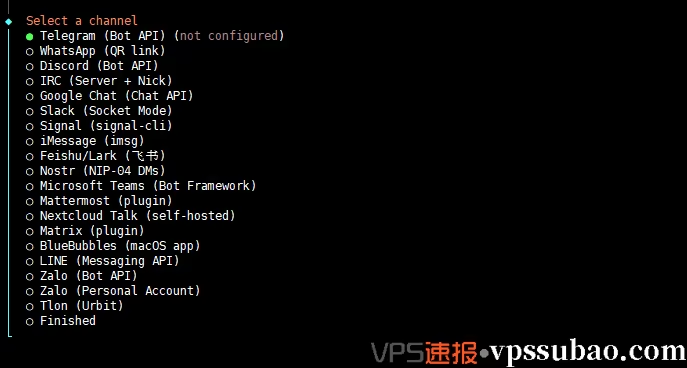

- 开启通讯渠道绑定 (Configure channels): 完成基础的网关安全设置后,向导会列出当前所有通讯平台的连接状态(Channel status)。为了让 AI 真正为您所用,我们需要将它接入到常用的聊天软件中。请在提示处保持默认的 Yes 并回车,开始选择您想要绑定的平台。

确认进入渠道配置,OpenClaw 支持 Telegram、Discord 等数十种平台接入

提示:OpenClaw 的魅力在于它的“全能型”,您可以同时绑定多个平台,让您的 VPS AI 助手成为您的全能社交管家。在本教程的下一步,我们将以最常用的 Telegram 为例进行演示。

OpenClaw 最核心的玩法就是将它接入各种通讯软件,让您随时随地通过聊天框与 AI 互动。在众多的平台中,Telegram 凭借开放的 API 接口和极简的配置过程,成为了广大 VPS 用户的首选。

- 选择通讯平台: 在渠道选择列表中,使用回车键选中首项 Telegram (Bot API)。

选择 Telegram (Bot API) 开启您的 AI 社交机器人之旅

准备工作:在进行下一步之前,请确保您已经拥有一个 Telegram 机器人。如果没有,请在 Telegram 中搜索 @BotFather,发送 /newbot 指令,按照提示即可在 10 秒内获得一串专属的 Bot Token。

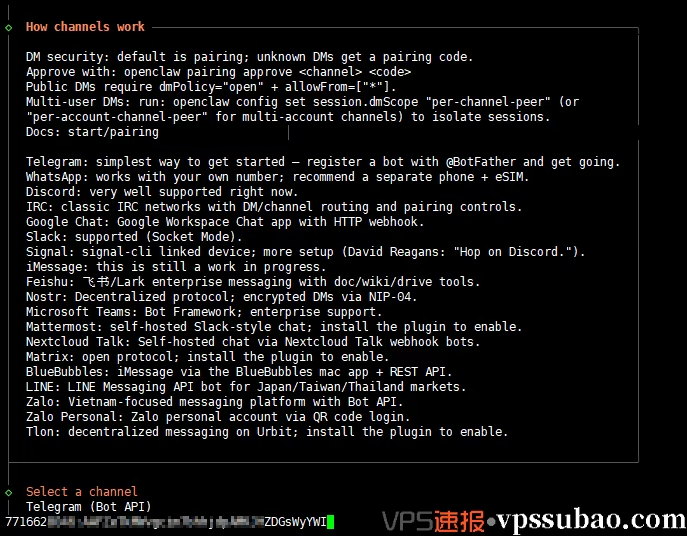

- 完成机器人绑定: 回到 VPS 终端,将刚才获取的 Token 完整粘贴到

Telegram (Bot API)提示行后,并敲击回车。

将获取到的 Token 粘贴至终端,让 OpenClaw 正式接管您的 Telegram 机器人

在完成 Token 绑定后,虽然机器人已经可以工作,但目前它是“不设防”的(任何知道机器人名字的人都能调戏它)。为了保障您的 API 额度不被滥用,建议在部署完成后,通过 OpenClaw 的管理命令或配置文件设置 Admin user IDs。这样,AI 助手就只会听从您一个人的指令,化身为您的专属私密助手。

- 确认绑定成功: 输入 Token 回车后,向导会返回频道列表。此时请确认

Telegram (Bot API)右侧是否已经出现了绿色的 configured 标志。

OpenClaw 部署教程:Telegram 渠道配置成功显示绿色 configured 状态

- 保存并正式运行: 确认无误后,使用下方向键移动到列表的最底部,选中 Finished 并敲击回车。此时向导会彻底保存您的所有设置,并开始在后台拉取 Docker 镜像启动 AI 服务。

移动到列表最下方选中 Finished 并回车,系统将正式保存所有配置并启动服务

- 设置私聊访问安全策略 (DM access policies): 退出渠道列表后,系统会询问是否需要手动配置私聊策略。系统非常贴心的默认开启了

pairing(配对验证)模式——这意味着任何陌生人私聊您的机器人,都会被自动拦截并要求配对,彻底杜绝了您的 API 额度被滥用的风险。 - 因此,对于绝大多数用户,这里我们直接保持默认选中的 No,敲击回车跳过繁琐的手动配置即可。

保持默认的 No 选项并回车,启用安全的陌生人配对拦截机制

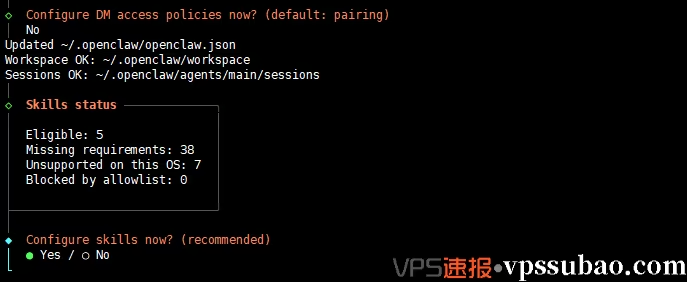

2. 为 AI 装备“超能力”技能 (Skills)

如果仅仅是聊天,那和普通的网页版 ChatGPT 并没有太大区别。OpenClaw 的杀手锏在于它强大的 Skills(技能/工具箱) 机制。这能让您的 AI 真正长出“手脚”,具备联网搜索、读写服务器文件、甚至直接执行代码的能力。

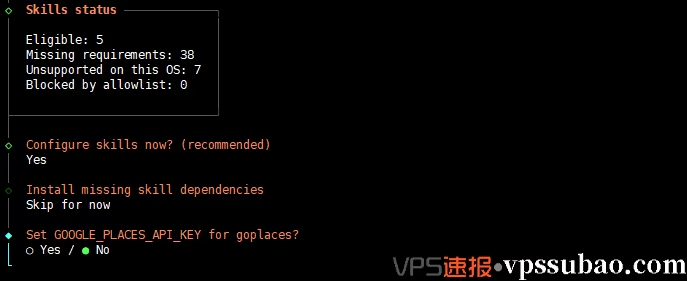

- 开启技能配置: 确认完私聊策略后,系统会自动检测当前环境可用的技能库(Skills status)。并在下方提示

Configure skills now? (recommended)。为了解锁 AI 的完全体形态,请务必保持默认的 Yes,并敲击回车进入配置页。

强烈建议选择 Yes 开启技能配置,为您的 AI 助手装备“超能力”

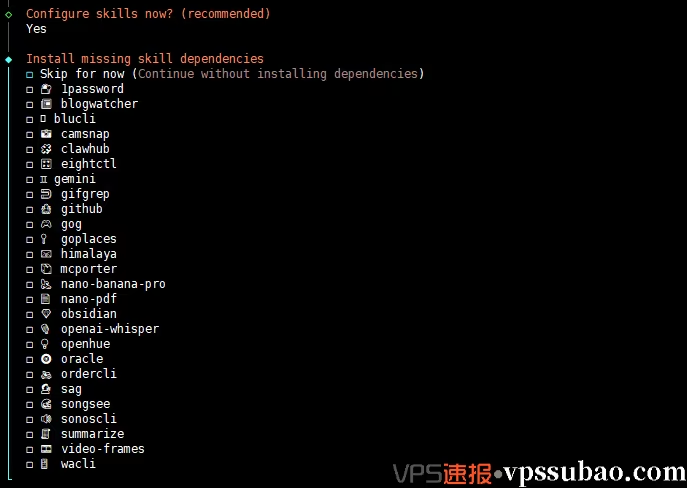

- 跳过复杂依赖安装: 进入技能配置后,系统会列出一长串带有缺失依赖的高阶技能(如 Github 联动、智能家居控制等)。由于这些技能通常需要额外的第三方配置,为了保证部署的顺利进行,建议新手直接保持默认选中第一项 Skip for now,并敲击回车跳过。

建议新手直接选择 Skip for now 跳过依赖安装,基础技能已足够日常使用

- 精准筛选:跳过复杂依赖安装。 很多新手在这里会有疑问:“上一步刚开启技能,这里为什么又要跳过?”

- 请注意,系统在这里列出的是 30 多项需要额外配置第三方环境的高阶插件(如 Github 联动、密码管理器 1password 等)。选择 Skip for now 仅仅是暂缓安装复杂的外部插件,绝不会影响系统自带的基础核心技能。

- 终端实操细节: 注意这是一个多选菜单,直接按回车系统会报错。请确保光标停在第一项 Skip for now 上,按下键盘上的 空格键 (Space) 将它选中(前面的方块会被勾选),然后再按下 回车键 (Enter) 确认提交。

小课堂:不用担心错过什么,OpenClaw 默认已经为您装载了最实用的基础技能(如联网搜索)。等您完全熟悉系统后,随时可以在管理后台一键添加这些高阶扩展。

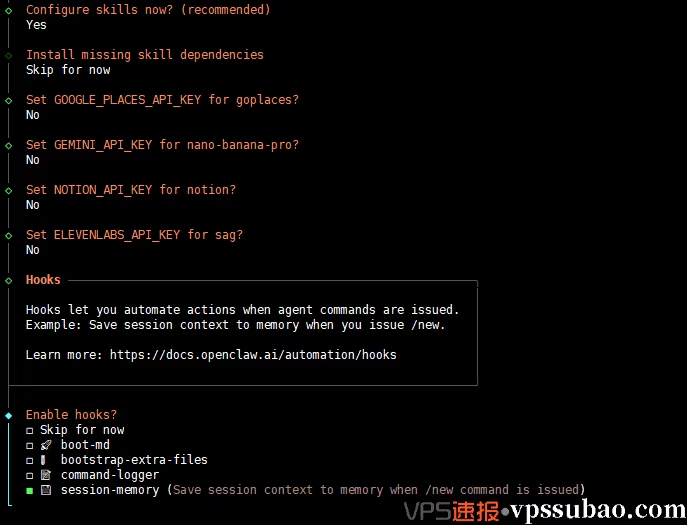

- 跳过可选的第三方 API 配置: 跨过依赖项后,系统可能会连续询问您是否要为某些特定技能(如 Google Places 地图检索、天气预报等)输入专属的 API 密钥。

- 由于我们搭建的是基础 AI 助手,且这些第三方 API 大多需要您去对应网站额外注册账号申请。为了快速跑通全流程,建议您遇到此类提示(如

Set GOOGLE_PLACES_API_KEY...),一律保持默认选项 No,并直接敲击回车跳过。以后有进阶需求时,再去后台单独配置即可。

对于不需要地图等额外功能的新手,遇到第三方 API 询问一律选 No 跳过即可

- 配置 Hooks 自动化钩子(高级记忆功能): 连续跳过 API 询问后,系统会弹出一个名为 Hooks 的新界面。很多朋友看到这里会疑惑:如果不选记忆,AI 是不是聊完上一句就忘了?

- 核心答疑: 请放心,基础的“聊天上下文连贯性”是 AI 原生自带的,不选这里也能正常聊天。列表里的

session-memory其实是更强大的“长期档案记忆”功能,它能在您切换新对话时,自动将历史聊天精华归档,实现跨越数月的长期记忆。 - 操作步骤: 为了让 AI 更加聪明,强烈建议开启此功能!请使用方向键将光标移动到最下方的 session-memory,按下键盘的 空格键 将它勾选。确保

Skip for now未被勾选后,按下 回车键 确认提交。

使用空格键选中 session-memory,为您的 AI 机器人开启强大的长期记忆归档功能

五、 启动服务与访问管理后台

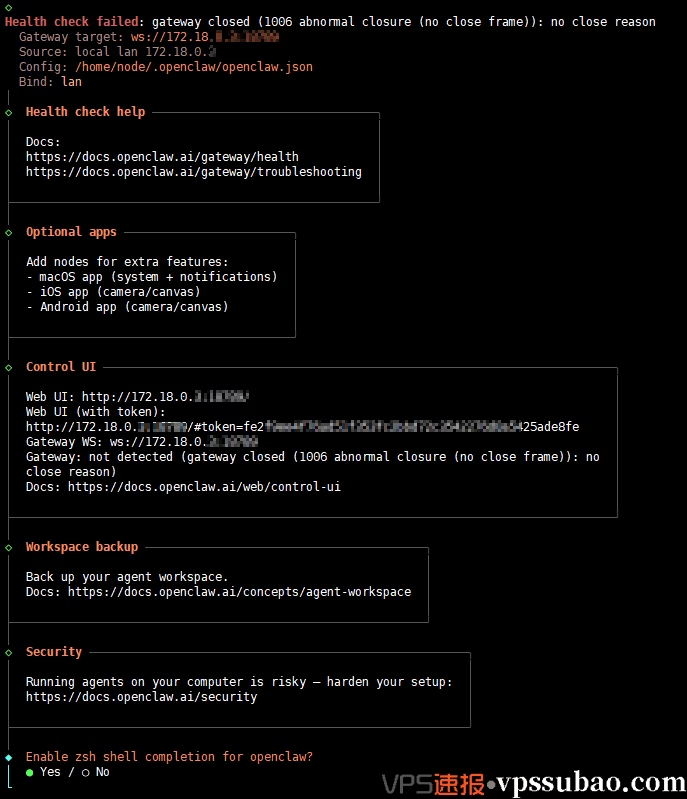

- 获取 Web UI 后台大门钥匙: 开启记忆功能后,系统会吐出一大段汇总信息。请不要被顶部的

Health check failed报错吓到,这仅仅是因为后台容器还在启动中,稍后会自动恢复。 - 重点操作: 请将目光聚焦到中部的 Control UI 区域。这里有一行

Web UI (with token)的超长链接。这是您免密登录网页管理后台的唯一凭证,请务必将它复制并妥善保存在记事本中! - 公网访问技巧: 注意,系统显示的链接 IP(如

172.18.0.x)是 Docker 的内网地址。在电脑浏览器中访问时,您需要将这个内网 IP 替换为您 VPS 的真实公网 IP(例如:http://您的公网IP:18789/#token=xxxx...)。 - 最后,向导会询问

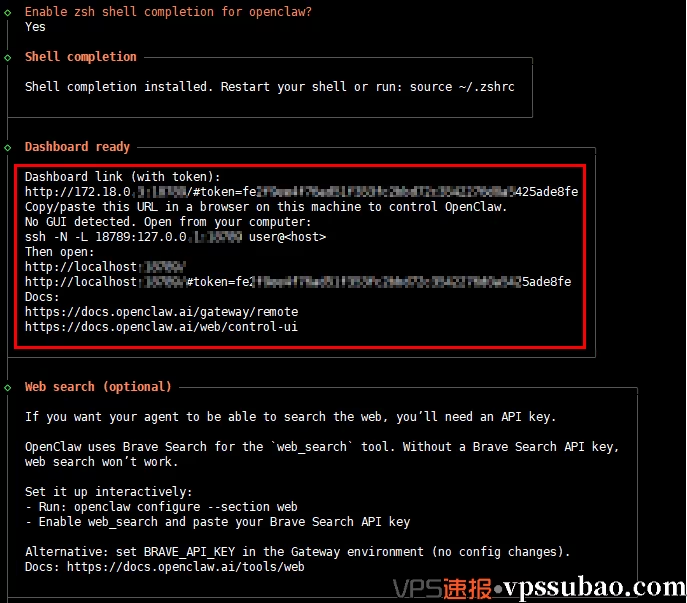

Enable zsh shell completion for openclaw?(是否开启命令自动补全),保持默认的 Yes 并敲击回车即可。

务必保存带有 Token 的 Web UI 链接,并回车开启终端命令自动补全

在确认完命令补全后,配置向导会输出长长的最终汇总信息。此时,向导已经正式结束交互,并在后台呼叫 Docker 拉取镜像、启动 OpenClaw 的核心服务。

- 获取终极控制台链接: 在输出信息中,找到

Dashboard ready区域。这里再次提供了一次带有 Token 的完整链接。

向导生成最终的 Dashboard 链接,这是您管理 AI 的核心入口

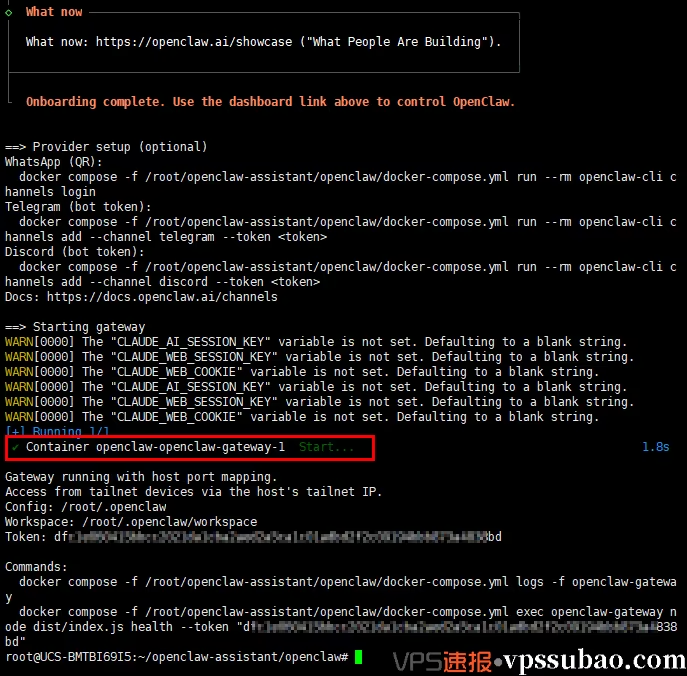

- 见证奇迹的时刻: 继续往下看,当您看到

Container openclaw... Start...的绿色字样,并且屏幕最下方重新出现了我们熟悉的root@您的主机名:~#命令提示符时,请尽情欢呼吧!这代表您的 AI 助手已经稳稳的运行在您的 VPS 上了!

看到绿色的 Start 和底部的 root 提示符,标志着 OpenClaw 已在后台完美运行

如何真正打开您的 Web 管理后台?

请注意,出于极高的安全标准,OpenClaw 的 Web 控制台强制要求在安全上下文(HTTPS 或 localhost)中运行。千万不要直接使用 http://您的公网IP:18789 访问,否则会被系统拦截并提示需要安全连接。

正确的访问姿势(SSH 隧道转发):

1. 打开您本地电脑的命令行终端(Windows 用户使用 CMD 或 PowerShell,Mac 用户使用 Terminal)。

2. 输入以下命令,打通本地与 VPS 之间的安全隧道(请将 198.51.100.1 替换为您真实的 VPS 公网 IP):

ssh -N -L 18789:127.0.0.1:18789 root@198.51.100.1

3. 输入服务器密码并回车,此时终端窗口会处于挂起状态(光标闪烁不动),这说明隧道已接通。请保持此窗口开启,不要关闭。

4. 打开浏览器的无痕模式,将刚才向导生成的带 Token 链接中的内网 IP 替换为 localhost 进行访问:

http://localhost:18789/#token=abcdefg...

这种通过专属 Token 参数进行安全验证的登录机制,在现代容器化面板部署中非常普遍且高效。如果您对这类带有极高安全级别的可视化管理面板感兴趣,我们在 K3s Dashboard 安装教程:3步解锁可视化管理 (含 Token) 中也有过类似的详细探讨。

敲击回车,您将看到一个极具科幻感、功能强大的可视化控制面板。同时,如果您在前面绑定了 Telegram 机器人,现在就可以去给它发送第一条问候语了!至此,OpenClaw 全套部署完美收官!

六、 常见疑难解答与进阶技巧

在首次登录或后续使用过程中,您可能会遇到系统严格的安全拦截,请参考以下方案解决:

1. 访问网页提示 disconnected (1008): pairing required 怎么办?

现象:这是 OpenClaw 的新设备安全锁,要求管理员手动批准新浏览器的接入。

解决:保持网页不要关。在 VPS 终端执行 docker compose run --rm openclaw-cli devices list。在返回的表格中,找到处于 Pending 状态的设备,复制 ID(如 vdev-xxxxx)。接着执行 docker compose run --rm openclaw-cli devices approve 刚才复制的设备ID 进行放行。完成后直接刷新网页即可进入。

2. 提示 device token mismatch 无法进入怎么办?

现象:当服务器容器重启或发生配置变更时,出于安全考虑,系统会自动刷新网关的访问令牌,导致您之前保存的链接失效。

解决:在 VPS 终端执行 docker compose logs openclaw-gateway | grep "Token:"。系统会输出当前最新生成的 Token 字符串。将它复制,替换掉浏览器地址栏 #token= 后面的旧字符,重新访问即可。

3. Telegram 机器人回复 access not configured 并给出一串 Pairing code 怎么办?

现象:因为在安装向导中开启了私聊配对策略,系统需要您在服务器端确认您的管理员身份。

解决:复制机器人在 Telegram 里发给您的配对码(例如 H6LPPZX7)。回到 VPS 终端,执行以下命令进行授权(请将最后面的代码替换为您自己的配对码):

docker compose run --rm openclaw-cli pairing approve telegram H6LPPZX7

执行后看到 Success 或 Approved 提示,说明您的 Telegram 账号已与服务器成功绑定。此时再去 Telegram 发消息,机器人就会正常与您对话了。

4. 终端配置 AI 模型时遇到 403 Country Error?

现象:您的 VPS IP 属地不在该 AI 模型的官方服务支持范围内。

解决:建议改用第三方 API 中转聚合服务(如 OpenRouter)。获取中转 API Key 后,在控制台将 Provider 设置为 OpenAI 兼容模式,并将 Base URL 修改为中转商提供的地址即可轻松绕过地域限制。